活用法の情報が溢れる中で流れを考える

かつてAIは「おもちゃ」と言われるほど、できることが限られていました。

それが今では、人間の仕事を支えるパートナーになりつつあります。

毎日のように新しいツールやアップデートが登場し、目的特化型のAIも次々と増えています。

この記事では、AI進化の背景とその流れを整理します。

AI技術がどこを目指しているのかを考えることでアップデート情報に振り回されず活用するための理解が進みます。

AIの進化を課題から捉える

AIの進化は、単なる技術革新の積み重ねではありません。

時代ごとに「何が壁だったか」「何を乗り越えたか」によって形を変えてきました。

ここでは、AIを支えてきた課題を軸に、その流れを整理します。

1950〜1970年代:理論は生まれたが、動かせなかったおもちゃ

1956年、ダートマス会議で「人工知能(Artificial Intelligence)」という言葉が誕生します。

当時の研究者たちは、関係ない事象と事象が論理で結びつくような人間のように考える機械を作ろうとしていました。

しかし、当時のコンピュータは高価で性能も低く、学習に必要なデータも存在しませんでした。

アルゴリズムの理論はあっても、計算資源とデータが圧倒的に足りていませんでした。

たとえば「猫とは何か」と尋ねても、AIは定義文を辿るだけで、画像や特徴を結びつける力はありません。

AIはまだ“アイデアの中の存在”にとどまっていました。

1980〜1990年代:知識を与えるアプローチの限界、自分では学習できない物知り

性能が少しずつ向上し、AIは「知識ベース」型へと進化します。

人間の専門知識をルール化して判断するエキスパートシステムが登場しました。

専門家が一つずつ「もし〜なら〜する」というルールを手作業で登録する方式です。 医療診断などでは一部成果が出たものの、ルールの追加や更新に時間がかかり現実的ではありませんでした。

2000〜2010年代:データと計算の壁を突破し、自分で学習するように

インターネットの普及で、テキスト・画像・音声といった膨大なデータがオンラインに溜まりはじめました。

それを処理できる計算力を支えたのが、GPU(グラフィックボード)です。

もともとゲームの画像処理用に作られたチップですが、同時に大量の数値計算をこなせるため、AIの学習速度を一気に引き上げました。

これにより、数週間かかっていた学習が数時間で終わるようになりました。

機械学習とディープラーニングが現実的に動き出し、画像認識や音声認識など、私たちの日常にも届き始めます。

2020年代:生成と協働のフェーズへ、生成AIの活用

現在のAIは、情報を分析したり分類したりするだけでなく、新しいものを生み出す存在です。

文章を考えるChatGPT、画像を描くStable Diffusionなど、いわゆる生成AI(Generative AI)です。

その進化を支えているのが、Transformer構造という新しい学習モデルです。

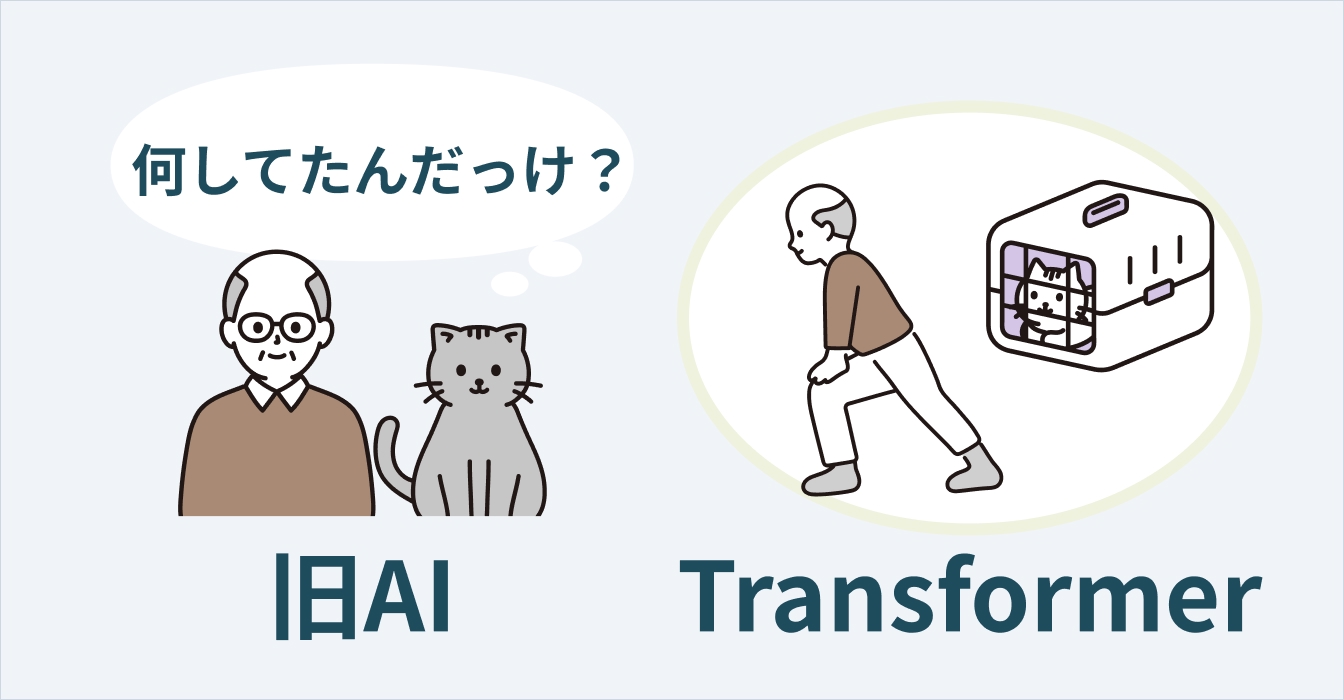

これまでのAIが言葉を順番に処理していたのに対し、Transformerは文全体のつながりを一度に理解できる仕組みを持っています。

例えば、以下のようなマルチ関係のある文章の理解について

「ストレッチをしているお爺さんをキャリーケースの中から猫が見ています。」

旧AIだとお爺さんがキャリーケースの中だっけ?など混同して理解することがありましたが、

Transformer構造では、お爺さんはストレッチ, 猫は見ている, とそれぞれの理解が一度に可能になりました。

2025年、協働の目指す先は共創?

もう今の時点ですでにAIは仕事の相棒です。

コーディングでは自分で構造を考えてコードを書けるようになり、GPT-5ではエージェントモードによって目的理解や行動設計も進化しています。(claude codeが動く様を見たときはかなり感動しました…!)

それでも、まだクリアできていない課題がいくつかあります。

意味理解

まだ言葉のつながりを「確率的に予測」しているだけで、本当の理解には至っていません。

長期的記憶

会話やタスクをまたいで情報を保持するのは苦手です。

倫理・責任

出力の正当性や判断の責任が曖昧です。

エネルギー効率

モデルが巨大化するほど、計算コストと電力消費も膨れあがります。

自律的判断

AIが「目的を理解して自分で計画を立てる」には、まだ壁があります。

GPT-5では2025年にエージェントモードが追加され、オンラインタスクの一部を実行できるようになりました。

ただし、ログインなどでは人の手が必要なケースが依然としてあります。

アップデート情報なんかをみても理解しきれない単語がたくさん並んでたりしますが、「軽くて速くて、自走できて、しかも倫理的に安全なAI」が実現できるとかなり仕事を任せることができるようになるのではないでしょうか。

- ダートマス会議(1956)

人工知能という概念が正式に提案された会議。

- エキスパートシステム

人間の専門知識をルールとしてAIに入力し、判断させる手法。

- GPU(Graphics Processing Unit)

画像処理向けに開発された並列演算チップ。AI学習の計算時間を劇的に短縮。

- 機械学習(Machine Learning)

人間がルールを教えるのではなく、データから自らパターンを学ぶ手法。

- ディープラーニング(Deep Learning)

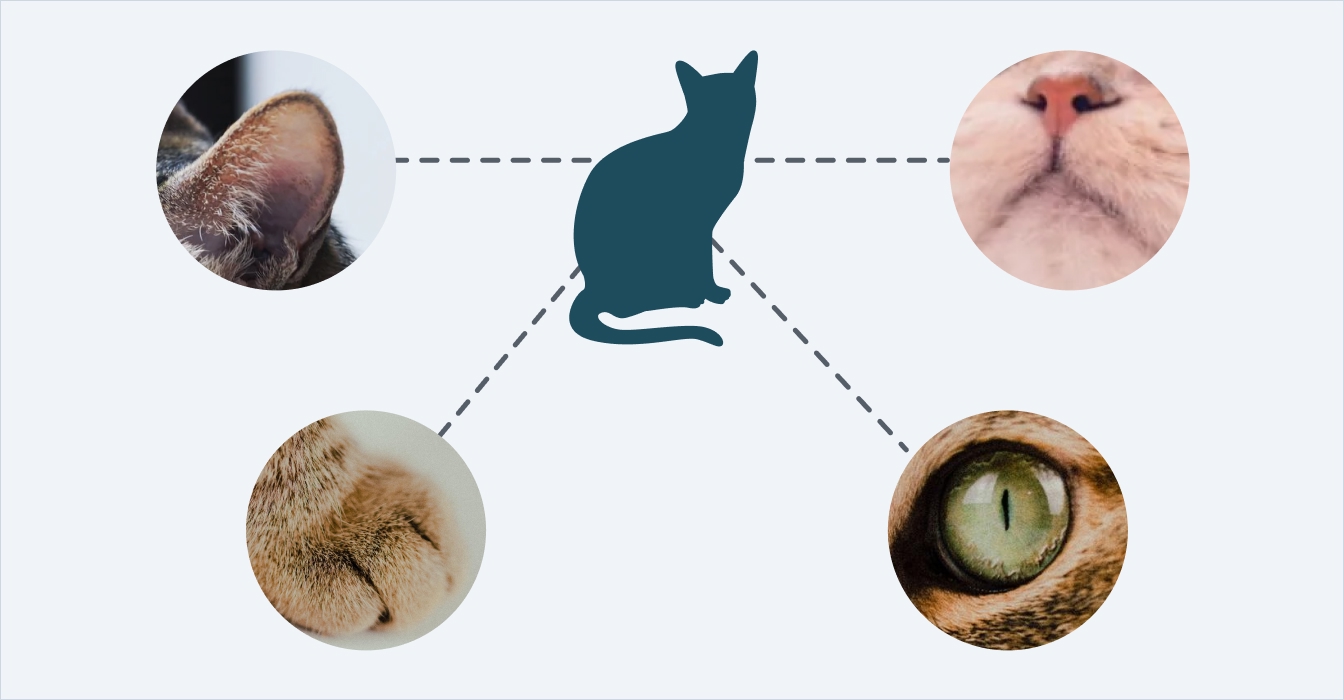

データを何段階にも分けて“見方を変えながら”分析していく仕組み

これまでは人間が「猫の耳はとがっている」「ヒゲがある」とルールを教える必要がありましたが、ディープラーニングではAIが自らパターンを見つけ、分類や認識を行えるようになりました。 - Transformer構造(2017)

従来の順番処理ではなく、文全体を同時に処理することで精度を飛躍的に高めたモデル。

- エージェントAI

目的を理解し、複数のタスクを自律的に実行できるAI。